L’automazione è oggi al centro di un’evoluzione profonda e pervasiva delle interazioni sociali e delle dinamiche economiche planetarie. Mira a conquistare e consolidare questa dominanza incarnandosi in forme sempre più fondative e sorprendenti dentro la storia della civilizzazione umana e dei suoi modi di produzione. Questa fase contemporanea di competizione strategica e di business experimentation abilitata dall’automazione ha caratteristiche nuove e distintive al punto che è stata anche riqualificata come “iperautomazione”. Per questo si vengono anche moltiplicando e diffondendo – sia pur con declinazioni varie, ma prossime di senso – espressioni come machine economy, agent economy, autonomous economy, artificial economy, solo per citare quelle più note. Dentro questo passaggio all’economia della macchina, oltre alla meccatronica e robotica più classiche (e in aggiunta anche a quelle più recenti della robotic process automation, della robotica a sciami o di quella cobotizzata dei sistemi industriali umano-macchina collaborativi e, in prospettiva, della robotica dei viventi con l’incrocio tra biologia e ingegneria), vanno oggi portate in maggiore evidenza e in analisi le automazioni di business prodotte dagli algoritmi di deep learning dell’intelligenza artificiale generativa (e tutte le FMOps relative: dai linguaggi macchinici, alle immagini sintetiche, agli agenti autonomi) oltre quelle abilitate dai protocolli crittografici delle varie ed emergenti organizzazioni decentralizzate autonome (tra self-employed robot, machine-customer, protocol fork). Stiamo entrando, dunque, in una stagione accelerata di “neoautomazione” che richiederà per certo nuove culture, nuove mentalità e, naturalmente, anche nuove competenze. È un’automazione al cubo (cubed automation) o, come l’ho anche definita, l’automazione delle 3M: mani, menti, mercati. Si automatizza la forza fisica, la capacità cognitiva, la relazione mercantile scardinando con radicalità forme organizzative classiche, antiche divisioni del lavoro e pratiche produttive consolidate. L’AI è infatti insieme, direbbero i greci, lògos e érgon, ragione e azione. Con l’erosione del paradosso cautelativo di Polanyi e con la messa in questione della polarizzazione dei task (umani bravi a fare alcune cose e le macchine a farne altre), nuove cognizioni del mondo e nuove divisioni del lavoro sono all’orizzonte. È dentro questa nuova dialettica coevolutiva intricata e non scontata tra automation (sostituzione), heteromation (subordinazione) e augmentation (aumentazione) che il lavoro umano dovrà riuscire a immaginare e costruire un suo nuovo e migliore futuro. L’AI non è dunque – come ingenuamente si dice – prodotto o servizio, ma proprio nuova fabbrica. Nuova fabrica mundi > (Accoto 2024)

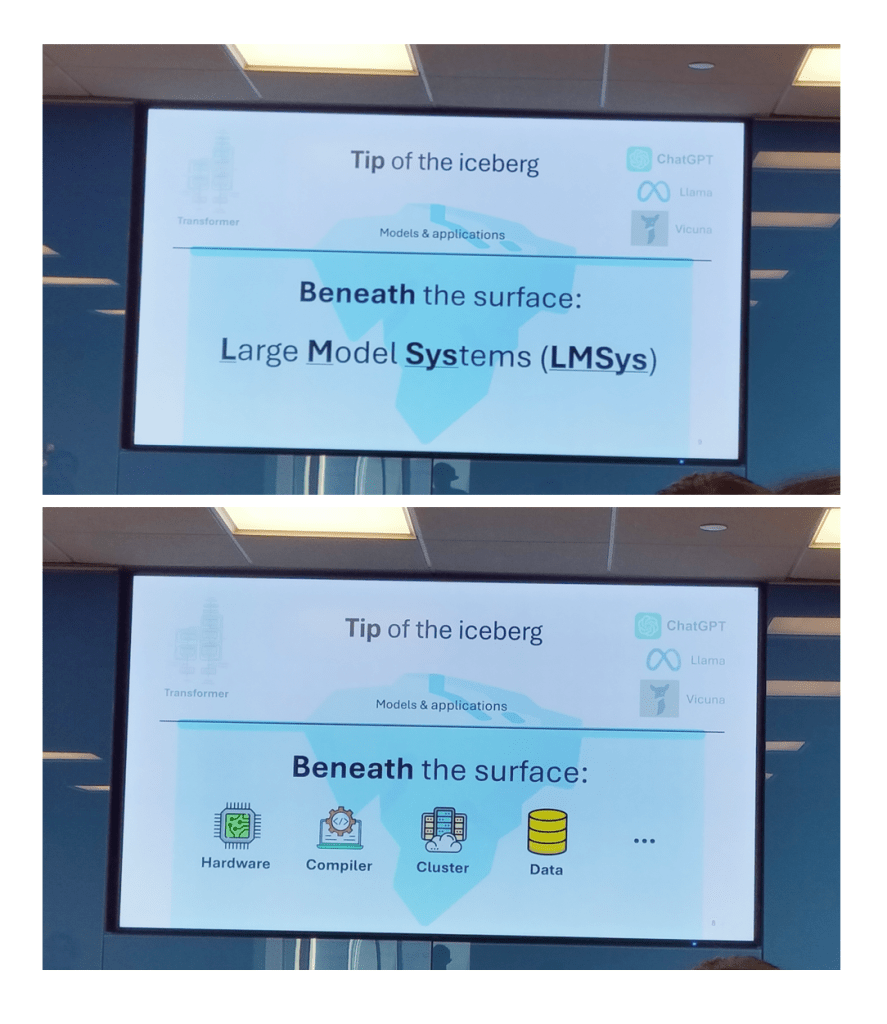

< Dai LLMs ai LMSys: dai modelli ai sistemi > (Accoto 2024)

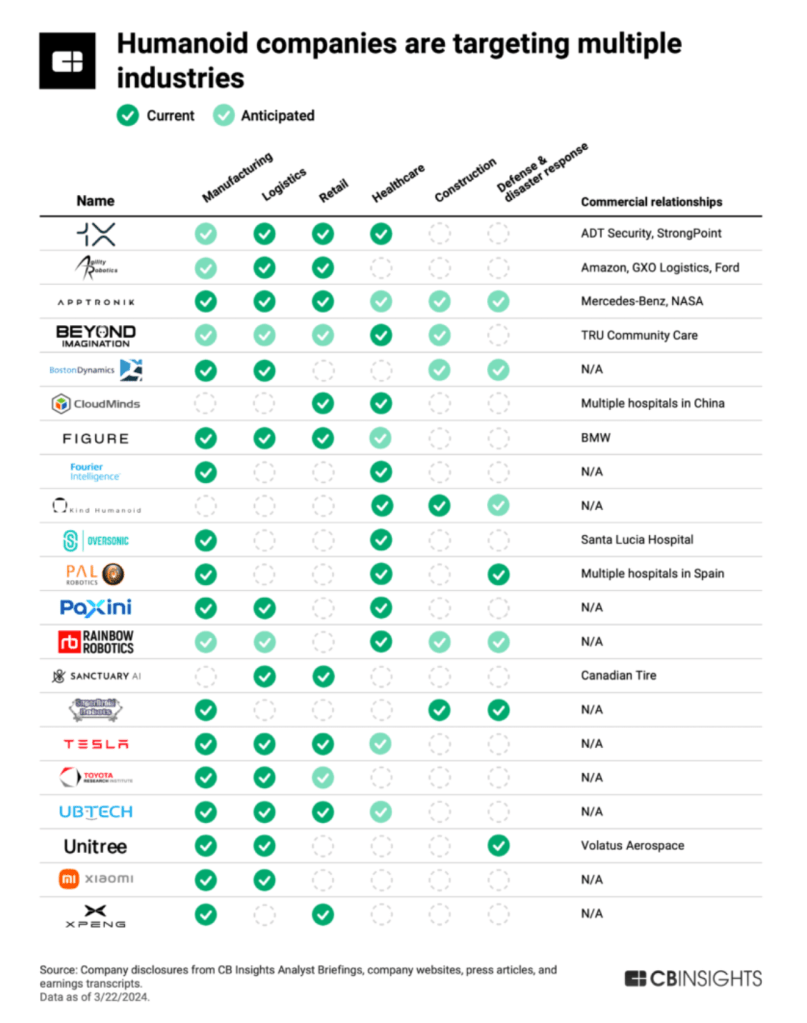

< Portare in produzione reale, a scala industriale e con modularità automatizzata efficiente e sicura (tra infrastrutture, macchine, dati, algoritmi e applicazioni) un modello linguistico fondazionale implica uno sforzo strategico e ingegneristico non indifferente e non da tutti. Il prompt engineering fatto dall’umano (a cui molti oggi fanno riferimento) è solo la punta sdrucciolevole e più nota di un icerberg sottostante invisibile, impermanente e intrattabile (e, tuttavia, da gestire in qualche modo). Progettare e costruire questo iceberg immaginandolo e implementandolo con tutte le sue complessità richiederà visione e strategia (e moneta e talento). Siamo chiamati ad una fatica erculea per molti versi e, in una certa misura, anche sisifea (utile o inutile questo dipenderà da come la faremo), sovrumana e insieme ininterrotta. Non so quanta consapevolezza diffusa ci sia in merito alla superficie e all’abisso di questo Pianeta Terra Digitale che ci accingiamo ad abitare. Temo sia poca e insufficiente. Così come è tutta ancora da costruire la cognizione filosofica di questa tettonica delle placche digitali. La cognizione del mondo si fa nuova, dunque, evocando pensieri (e strumenti) inesplorati e sorprendenti. Provocanti, in una significativa misura. Perchè con il dispiegarsi planetario dell’intelligenza artificiale, noi non affronteremo solo problemi tecnici con vulnerabilità e rischi reali di discriminazioni, manipolazioni, deprivazioni, polarizzazioni, alienazioni, contraffazioni. Piuttosto e più radicalmente noi fronteggeremo delle provocazioni intellettuali. A partire da quella primaria sulla natura dell’umano (chi siamo? o meglio, chi diveniamo?) declinata poi in molte altre domande di senso e di scopo: può esistere una scrittura impermanente senza l’autore come accade per i modelli linguistici su larga scala? e una fotografia realistica senza rappresentazione isomorfica come avviene per le immagini sintetiche? e un’autonomia decisionale astensiva -e non estensiva- dell’umano come immaginata dagli agenti artificiali? Questi non sono solo problemi. Sono provocazioni. E se ai problemi tecnici lavoreremo, nel tempo e a tentativi, per trovare una soluzione ingegneristica di qualche tipo (informatica, legale, istituzionale e così via), alle provocazioni intellettuali dovremo invece rispondere, di necessità, con l’innovazione culturale. A questo compito più alto siamo oggi chiamati tutti e tutte (superando l’attuale deriva anestetica dell’etica): alla produzione di nuovo senso e di nuovi significati per questo nostro abitare terrestre con le sue nuove zolle computazionali … > (postilla a “The Latent Planet”, Accoto 2024)

(images: “Scalable and Efficient Systems for Large Language Models”, Lianmin Zeng, marzo 2024)

Dai bracci meccanici agli abbracci robotici (Accoto 2024)

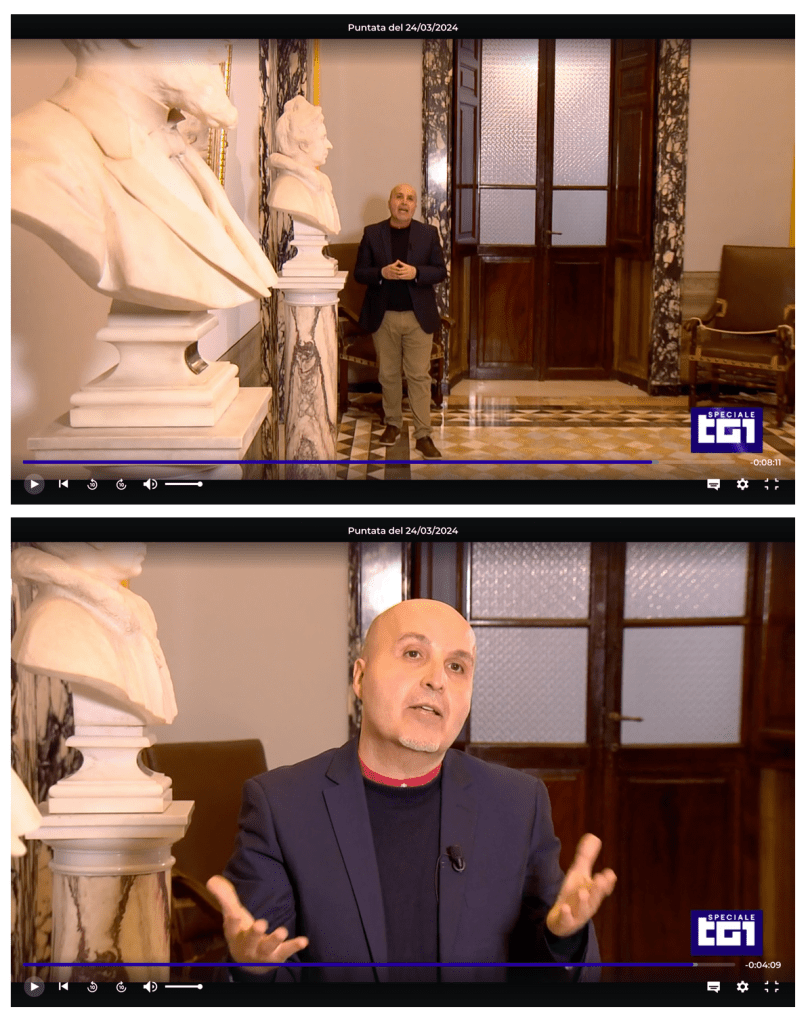

“Noi e loro. Gli umani al tempo dei robot” è lo Speciale TG1 di Barbara Carfagna dedicato all’evoluzione e alla declinazione della robotica umanoide per come viene sviluppandosi in giro per il mondo. Ieri sera su RAI 1, una puntata ricca di prospettive e progetti planetari che ci porteranno, non senza complessità, dalla robotica industriale alla robotica sociale. Tra opportunità e vulnerabilità, lungo tutta la puntata i miei diversi interventi per collocare e leggere in una prospettiva culturale e filosofica questo passaggio (non scontato e non semplice) dai “bracci meccanici” agli “abbracci robotici” come l’ho definito con un’immagine evocativa. Un grazie a Barbara Carfagna per l’invito ad accompagnarla e a contribuire in questa puntata dello Speciale TG1. In caso di interesse, l’intera puntata di ieri sera si può rivedere su RAI Play

Dai LLMs ai LMSys: dai modelli ai sistemi (Accoto 2024)

< Portare in produzione reale, a scala industriale e con modularità automatizzata efficiente e sicura (tra infrastrutture, dati, algoritmi e applicazioni) un modello linguistico fondazionale implica uno sforzo strategico e ingegneristico non indifferente e non da tutti. Il prompt engineering fatto dall’umano (a cui molti oggi fanno riferimento) è solo la punta sdrucciolevole e più nota di un icerberg sottostante invisibile, impermanente e intrattabile (e, tuttavia, da gestire in qualche modo). Progettare e costruire questo iceberg immaginandolo e implementandolo con tutte le sue complessità richiederà visione e strategia (e moneta). Siamo chiamati ad una fatica erculea per molti versi e, in una certa misura, anche sisifea (utile o inutile questo dipenderà da come la faremo), sovrumana e insieme incessante. Non so quanta consapevolezza diffusa ci sia in merito alla superficie e all’abisso di questo Pianeta Terra Digitale che ci accingiamo ad abitare. Temo sia poca e insufficiente. Così come è ancora tutta da costruire la cognizione filosofica di questa nuova tettonica delle placche digitali … > (postilla a “The Latent Planet”, Accoto 2024)

(fig. 1. “Scalable and Efficient Systems for Large Language Models”, Lianmin Zeng, marzo 2024)(fig.2. “Building More Reliable and Scalable AI Systems with Language Programming” (Omar Khattab, marzo 2024)

Dai LLM ai LMSys: AI o della cognizione sintetica del mondo (Accoto 2024)

< Chi e come (si) conosce il mondo? L’intelligenza umana incorporata ha dominato il campo dell’osservazione e della cognizione del reale per lungo tempo reclamando a sè il primato della conoscenza del mondo. Lo ha fatto, almeno alle nostre latitudini, escludendo da queste possibilità animali e piante (eludendo, tra gli altri, il tema complesso delle ‘altre menti’ o delle ‘menti possibili’ oltre a quello delle ‘menti estese’). L’arrivo della cosiddetta intelligenza artificiale sembra aver nuovamente risvegliato questa supponenza umanocentrata. Almeno secondo due prospettive. Una prima tendenza incarna un umanesimo impaurito o arrabbiato. La seconda è, per converso, superficialmente entusiasta e tecnicamente galvanizzata. Quello timoroso o infuriato, a seconda dei casi, è un umanesimo che di fatto si ripiega su di sé (teso com’è a ricercare la sua essenza distintiva unicizzante e ad aggrapparsi a quella per cercare di preservare un nucleo eccezionale fondativo dagli attacchi della tecnica). Quello acclamante ed eccitato è viceversa un umanesimo in molti casi vittima in/consapevole dei propri antropomorfismi e sociomorfismi (si limita, cioè, a leggere l’AI come rispecchiamento/simulazione delle proprie capacità o, meglio, di quello che si pensa essere il modo dell’umano di percepire, osservare, conoscere, agire il mondo). Entrambe queste prospettive sono deboli e ingenue, pregiudizievoli e limitate e di parte. Ad osservare, conoscere e operare il mondo non è più solo “l’umano” (se mai fosse stato l’unico). Forme di osservazione, di cognizione e di esecuzione ‘more-than-human’ (macchiniche, rizomatiche, prolettiche, simpoietiche, chimeriche, alterosomiche, catallattiche, programmatiche, automatiche) sono da qualche tempo in divenire e in dispiegamento. Ci chiedono di allargare il nostro sguardo oltre i confini culturali dati del naturale, del nativo, dell’autentico, dell’essenziale, del corporeo umanomorfico. E nel caso dei modelli linguistici (LLMs e varianti) di considerare non solo la punta dell’iceberg (modelli e applicazioni), ma l’intera infrastruttura che istanzia quelle capacità linguistico-macchiniche nuove (LMSys*). Così occorre passare dall’esame dei “modelli linguistici su larga scala” alla comprensione dei “sistemi dei modelli linguistici su larga scala” (*Zeng, 2024, Scalable and Efficient Systems for Large Language Models), vale a dire all’intera infrastruttura/infostruttura hardware/software che produce poi quella “cognizione” sintetica programmabile, automabile, componibile come punta dell’iceberg. Cogliere questa emergenza filosofico-ingegneristica è parte dell’innovazione culturale necessaria a significare nuovamente e prosperare strategicamente nell’era della cognizione sintetica post-antropocentrica” (Accoto 2024)

VLLMs: dall’immagine alla parola (Accoto 2024)

< Video LLMs: dall’immagine alla parola? > (Accoto 2024)

< Come si passa tecnicamente dai frame visuali di lunghezza crescente ai token testuali che descrivono azioni e comportamenti in un video (Video LLMs)? Come fa una macchina a guardare e interpretare un filmato lungo e rispondere ad una “video query”? Ad oggi la pratica video-to-text è limitata a pochi secondi (10-15 in genere), ma il tentativo che si sta facendo (qui ad esempio Meta, Adobe e Boston University) è quello di estendere la capacità delle macchine di leggere le immagini filmiche e di individuarne il contenuto anche in video di lunghezza crescente. Ma come si tenta di farlo, oggi, tecnicamente? Entrare in profondità nelle tecnicalità in costruzione dell’AI generativa consente di valutare in prospettiva opportunità e vulnerabilità in termini di strategie di business e pratiche sociali. Ma consente anche da un punto di vista più filosofico di affrontare nuovamente la questione della relazione tra mondo e linguaggio, tra realtà registrata dalle macchine e modi di interpretarla delle macchine, tra segno del mondo e senso del mondo … > Accoto 2024 (postilla a “The Latent Planet”, 2024)

AI Forum 2024 (VI edizione, Accoto)

[evento] Sarò ospite e speaker al prossimo AI Forum 2024 (VI edizione), il Forum dell’Associazione Italiana per l’Intelligenza Artificiale dedicato alle imprese. Un grazie agli organizzatori e in particolare al prof. Gianluigi Greco Presidente di AIXIA (Associazione Italiana per l’Intelligenza Artificiale) e ora anche Coordinatore del Comitato del Governo Italiano per le Strategie sull’AI per l’interesse verso le mie esplorazioni filosofico-ingegneristiche sull’intelligenza artificiale e per l’invito amichevole a contribuire a questa nuova edizione. Ci vediamo di persona a Milano il 4 aprile a Palazzo Mezzanotte insieme ad un super interessante e nutrito gruppo di speaker

Back to MIT campus (Accoto 2024)

|| terremotare – terraformare il mondo || Accoto 2024

Una mia lunga intervista su Ad Media Lab (grazie a Roberto Siconolfi per lo stimolo delle domande

“La prerogativa storica della parola (simulata) ai soli umani mostra segni di cedimento. Passaggio che la teoria letteraria e la filosofia continentale avevano anticipato. In questo senso l’AI generativa è, come ho scritto, una provocazione di senso (che cos’è la scrittura? ci importa chi è l’autore? chi può parlare?) … così facendo si terremota il precedente assemblaggio sociotecnico per l’appunto e se ne terraforma uno nuovo tutto da costruire…” (Accoto 2024)