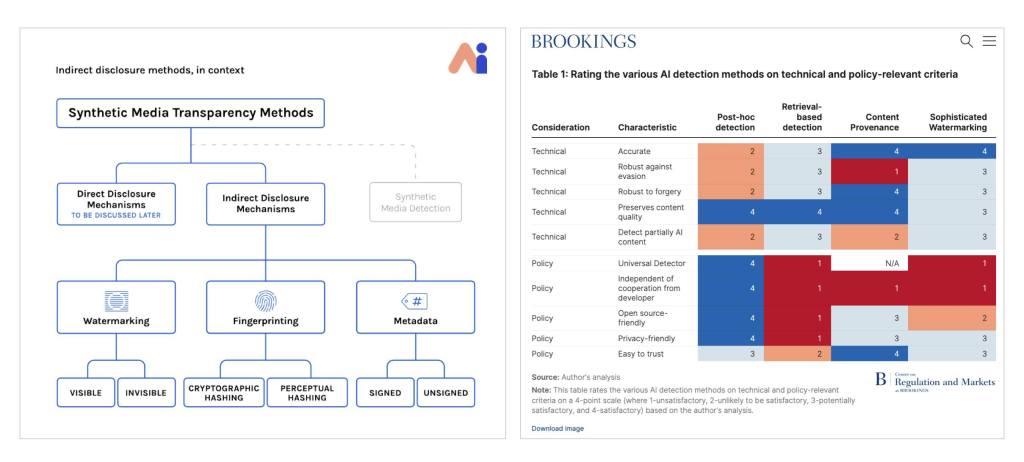

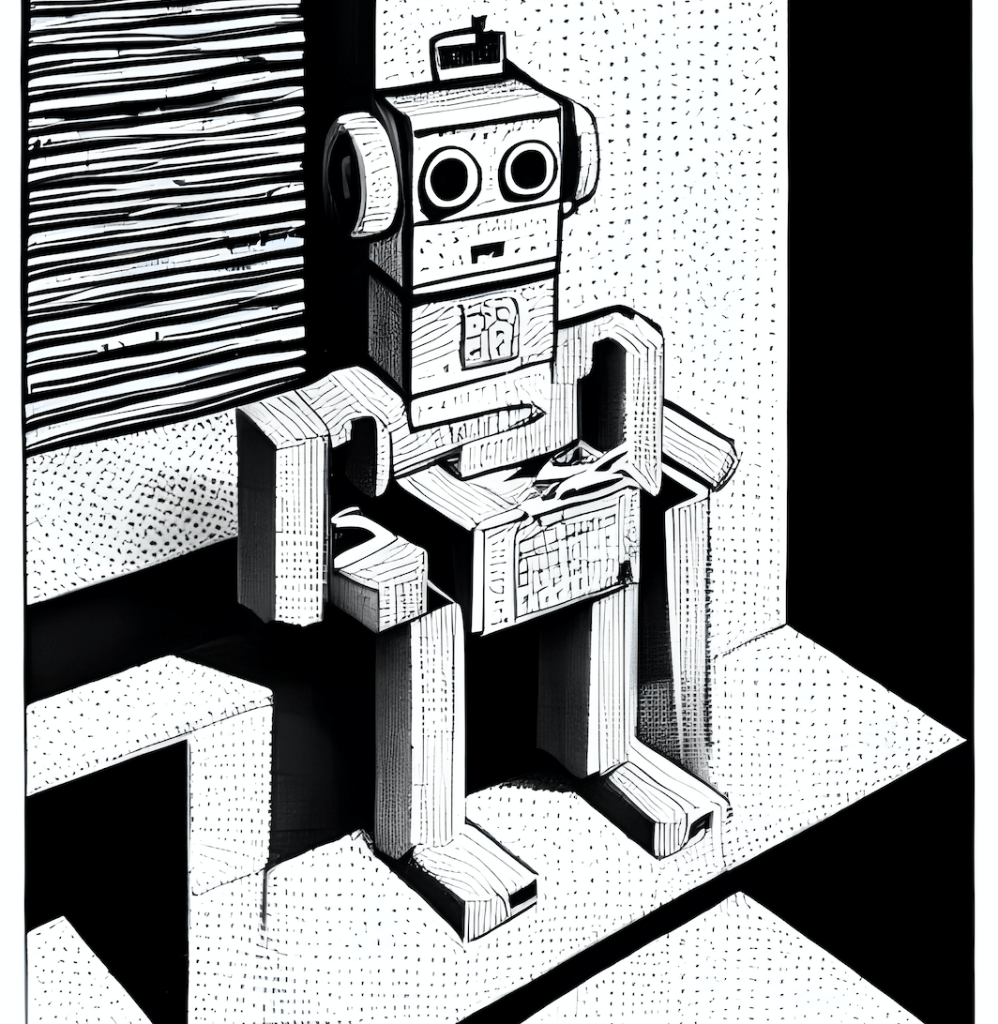

< L’uncanny valley dell’intelligenza artificiale generativa istanzia, di fatto, una nuova era mediale inflazionaria in virtù di linguaggi sintetici, immagini artificiali, agenti autonomi. Il che produce filosoficamente e operativamente lo scardinamento dei regimi di verità e falsità storicamente dati e agiti fino ad oggi oltre che un attacco alla rappresentazione della realtà anch’essa storicamente data e connotata. Insieme a questo, si avvia anche la necessità politico-economica di ricostruire il senso della “verità” e quindi la produzione delle condizioni sociotecniche della sua possibilità (condizioni di esistenza, di esperienza, di intelligenza). Che sono, da ultimo, questioni di politica e di potere. Conseguenza attesa, naturalmente, di questo cambio anche i connessi impegni umani rispetto ai futuri regimi di verità. È in questa prospettiva che dobbiamo leggere gli sforzi attuali di discriminare e certificare, allora, l’umano dalla macchina, il vero dal falso, l’originale dalla copia, il fatto dal contraffatto. Il nuovo “vero” si instanzierà come processo-evento di uno stack di protocolli e primitive che presiedono, nella forma di nuovi assemblaggi umani-macchine, alla produzione, circolazione e conservazione della “verità” del mondo (qualità, autenticità, veridicità, autorialità, credibilità, affidabilità …). È in accelerazione, dunque, lo sviluppo di soluzioni informatiche e standard computazionali vari (sophisticated watermarking, content provenance, retrieval-based detection, post-hoc detection*) che cercano di contemperare, in qualche misura, technology e policy. Con pro e contro, ovviamente, tra watermarking, fingerprinting e metadati. Attraversare (e abitare già in qualche senso) queste nuove uncanny valley si preannuncia come una sfida epocale e planetaria, complessa e arrischiata. Anche questa è una provocazione di senso dell’AI come ho scritto altrove. Sono e saranno le macchine (ovvero: nuovi assemblaggi umano-macchinici cognitivi e decisivi) a discriminare il vero dal falso e non in primis il nostro sensorium? Dai server di posta elettronica che separano le email dallo spam ai data center bancari che distinguono accessi legittimi da accessi fraudolenti alle architetture che certificheranno notizie vere rispetto alle fake news? La condizione umana, politica e ingegneristica insieme, è nuovamente e arrischiatamente chiamata in questione … > (postilla, Accoto 2024, “The Latent Planet. The Inflative Age of Generative AI”

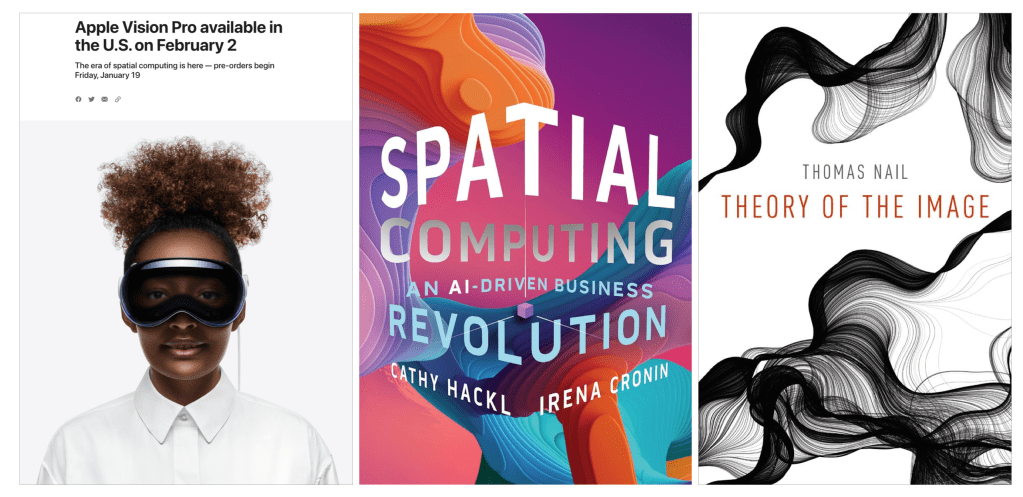

– Partnership on AI, Synthetic Media Transparency Methods: Indirect Disclosure, AI blog post, 2024 (Fig.1);

– *Srinivan, Detecting AI fingerprints: A guide to watermarking and beyond | The Brookings Institution, 2024 (Fig.2);