Back to MIT campus per continuare le mie esplorazioni filosofiche indisciplinate … ed è il tempo del mio pensare arrischiato e della mia nuova scrittura

philtech | philosophy | technology | culture | innovation | AI | planetary | intelligence

Una mia lunga intervista su Ad Media Lab (grazie a Roberto Siconolfi per lo stimolo delle domande

“La prerogativa storica della parola (simulata) ai soli umani mostra segni di cedimento. Passaggio che la teoria letteraria e la filosofia continentale avevano anticipato. In questo senso l’AI generativa è, come ho scritto, una provocazione di senso (che cos’è la scrittura? ci importa chi è l’autore? chi può parlare?) … così facendo si terremota il precedente assemblaggio sociotecnico per l’appunto e se ne terraforma uno nuovo tutto da costruire…” (Accoto 2024)

<< È opinione comune e discorso circolante che bisogna ‘governare la tecnologia’. Da ultimo, in ordine di tempo, quella dell’intelligenza artificiale. A fronte delle arrischiate uncanny valley che stiamo attraversando (e, in una qualche misura, anche già abitando), si sollevano richieste accorate di mettere a governo (giuridico, etico, sociale, politico…) le ondate tecnologiche in essere e in divenire. Vulnerabilità e rischi di varia natura sono i fattori scatenanti queste volontà disciplinari e normative. Naturalmente, c’è un che di condivisibile e consolante (e anche di giusto) in questi richiami alla governabilità della dimensione tecnica. E, tuttavia, mi sembra però anche che queste esortazioni governamentali palesino tutte, in fondo, una certa naïveté culturale e filosofica. In che senso diciamo che la tecnologia è governabile? A quali condizioni immaginiamo si possa governare? Come, quando e per cosa deve essere sottoposta a governo la tecnica? Le sue fondazioni o le sue applicazioni? Le innovazioni del presente o le loro conseguenze all’orizzonte? E che dire dell’economia politica della tecnica? È solo ingegneria o è anche e soprattutto economia politica? Va da sé che, se necessita di regole, è perché è ritenuta o incapace di auto-governo (inabilità) oppure addirittura proprio renitente al governo (indisponibilità). L’ingovernabilità è temuta e negata. In tutti i casi e comunque, la governabilità è data e presupposta. La tecnologia è governabile, si può governare e si deve governare. E così sempre più, principi, valori, modelli, leggi, regole sono evocati dall’esterno per incatenare, prometeicamente, una tecnica scatenata. Con un paradosso, la cibernetica, scienza massima del controllo, richiederebbe di essere a sua volta controllata. Ma è proprio così? E se, invece, ruotando la questione, il governo delle nuove tecnologie non fosse anche e soprattutto da ultimo un tema di tecnologie del nuovo governare? E se (come suggeriscono Berg, Davidson, Potts) dopo aver costruito le “macchine” di Turing, fosse in cantiere anche l’idea di costruire le “istituzioni” di Turing? Se così fosse la questione del governo della tecnologia va ripensata radicalmente rispetto agli attuali modelli e discorsi che mi sembrano umanamente comprensibili e necessari anche, ma ingenui filosoficamente e digiuni politicamente. Dunque, fatte le macchine (Turing machines), bisognerà fare le istituzioni corrispondenti (Turing institutions)? A noi spetta di cogliere criticamente questo nuovo passaggio e divenire dell’agire politico (e/o impolitico, direbbe Esposito). Dove impolitico non significa antipolitico, ma ‘il politico stesso guardato dal suo confine esterno o interno’ (Esposito). Dunque, quali nuove progettualità, quali opportunità e vulnerabilità emergeranno dall’impolitica dell’intelligenza artificiale? >> (Accoto 2024)

* image: An Ecosystem Framework of AI Governance, Wirtz, Langer, Weyerer

Sarò ospite e speaker al prossimo AI Forum 2024. Un grazie agli organizzatori e in particolare al prof. Gianluigi Greco Presidente di AIXIA (Associazione Italiana per l’Intelligenza Artificiale) e ora anche Coordinatore del comitato del Governo Italiano per le strategie sull’AI per l’interesse e per l’invito amichevole a contribuire a questa nuova edizione

[evento] Un frame dell’incontro organizzato settimana scorsa da Il Prisma a Milano. Il mio talk su < Il digitale come ambiente estremo > (al pari dello spazio extraterrestre con Valentina Sumini e della montagna d’alta quota con Emilio Previtali). Un grazie a Walter Mariotti (direttore di Domus) per la moderazione e l’invito e a Stefano Carone (founder e managing partner di Prisma) per l’accoglienza e l’apprezzamento. Una conversazione intorno al migrare e all’abitare anche in ambienti estremi come i pianeti extraterrestri con l’architetta spaziale Valentina Sumini oppure sulle montagne oltre gli 8000 con l’esploratore e alpinista Emilio Previtali. Il mio passaggio concettuale ha raccontato il cambio di paradigma da Blue Marble (fotografia, 1972) a Earth-2 (simulazione, 2022) esplorando il digitale come ambiente estremo (dal codice/scrittura di programmazione agli algoritmi di intelligenza artificiale generativa). Ho ricordato, en passant, lo stupore e lo shock del filosofo Martin Heidegger di fronte alle prime fotografie del nostro pianeta in bianco e nero scattate dal satellite Lunar Orbiter 1 nel 1966. Come allora dovremo tornare a chiederci sorpresi e spaesati: cosa e come diviene l’umano in questa migrazione dal Pianeta Terra Analogico verso il Pianeta Terra Digitale, in questa nuova terraformazione che stiamo evocando che è, da ultimo, un’esperienza di spaesamento (e non di allineamento)? Di nuovo un grazie a Walter e Stefano per l’invito

< Dalle reti ai programmi dalle nuvole ai modelli (network, software, cloud, machine observability), l’osservazione dei sistemi informatici e computazionali è divenuta pratica vitale per la gestione operativa e l’innovazione di business digitali, architetture di rete e dispositivi artificiali. Da ultimo, portare in produzione un modello linguistico (LLM) richiederà a imprese e organizzazioni di affrontare nuovamente e ulteriormente la questione ingegneristica dell’instrumentazione dell’osservabilità di risultati e comportamenti macchinici, in buona misura indeterministici e imprevedibili. Come valutare e come assicurare, allora, l’affidabilità di modelli e dispositivi linguistici su larga scala che incrociano, in maniera interconnessa, stratificata, dinamica oltre che fortemente innovativa, la computazione macchinica e la comunicazione umana, l’operazione di calcolo e il senso della parola? Pensare tecnicamente e strategicamente l’osservabilità significa progettare la capacità di comprendere al meglio il comportamento interno di un sistema (nel nostro caso un LLM in produzione) in base ai dati esterni (generati in fase di esecuzione) costantemente monitorati nei loro segnali informativi al fine di ottenere conoscenze rilevanti destinate a influenzare il sistema stesso.

“On the other end of the spectrum, in many cases an LLM is completely un-debuggable in the traditional sense. You can’t load debug symbols and step through each phase of execution with an LLM like you can with most software. Unless you’re an ML researcher by profession, chances are you don’t have any way to explain why an LLM emits a particular output for a given input. Yes, there are some controls you can place on it to affect the randomness of outputs—namely, the temperature and top_p sampling parameters—but they don’t guarantee repeatability of outputs. And when you combine this with an excessively broad class of inputs like natural language, you’re left with a system that’s incredibly powerful but very difficult to understand and guide into good behavior … Put differently, you should be aware of the following things when building with LLMs: Failure will happen—it’s a question of when, not if; Users will do things you can’t possibly predict; You will ship a bug fix that breaks something else; You can’t write unit tests for LLMs (or practice test-driven development); Early access programs won’t really help you” (Carter, 2024).

Dunque, chi e come (si) conosce il mondo e i suoi linguaggi sintetici in espansione? Nuovi attanti dell’osservazione, nuovi assemblaggi dell’osservabilità, nuove epifanie dell’osservabile si stanno evocando e si stanno producendo. Umane e sovrumane. E non si tratta solo di un modo più complesso di osservare, ma proprio di un modo nuovo dell’osservare > (Accoto 2024)

< L’atto del decidere (e dell’agire) collassa una particolare idea (ipotesi) del futuro. Se il passato risulta essere immutabile poiché nessuna decisione presa nel presente potrà più modificarlo (escludendo i viaggi nel tempo), il futuro avrebbe la qualità di essere mutabile e di dipendere in questo, per l’appunto, dalle nostre decisioni al presente. In questa prospettiva (ma ne esistono altre e anche contrarie come insegnano le diverse filosofie del tempo), è come se il mondo ramificasse costantemente futuri possibili da cui derivano i presenti che le nostre decisioni attualizzano. Nostre oppure di (con) altri modelli/agenti dotati dello stesso potere di presentificare il mondo, cioè di creare il nostro presente. Perchè di fatto l’automatizzazione algoritmica dei processi decisionali mette oggi in questione la visione dei sistemi di supporto alle decisioni come mere tecnologie “estensive” dell’umano. Piuttosto fa emergere l’idea di sistemi di sottrazione delle decisioni e cioè di tecnologie “astensive” dell’umano (ostensive > estensive > astensive dell’umano). O, meglio, nell’assemblaggio dinamico, perturbato e stratificato umani-macchine, l’arrivo dell’intelligenza artificiale riconfigura radicalmente modi, tempi, luoghi e agenti del decidere e della decisione. E del potere e della politica. Human-in-the-loop si dice, ingenuamente, ma ci si dimentica di dire che l’umano e il loop di domani non saranno più quelli di ieri e di oggi. La macchina artificialmente intelligente, dunque, come attore/agente/attante in cerca di autonomia (operational autonomy) che si costruisce computazionalmente modelli del mondo (e del business) e che sta tra il processare le informazioni sulla situazione e la scelta di comportamento da intraprendere per attualizzare uno dei futuri possibili (tutti calcolati probabilisticamente). Quello migliore (meno rischioso e più opportuno per l’impresa), si dice, avendo l’AI capacità predittive più-che-umane (o diversamente umane o macchiniche proprio e anche in condizioni cognitive estreme). Ma, chiediamoci, possiamo e come esserne certi? Certo, la macchina può (come l’umano) istanziare modi del fallimento del processo decisionale nuovi e assai rischiosi. Uno degli snodi filosofici per me più rilevanti è però qui un altro: siamo sicuri di sapere che cosa sia, filosoficamente, un errore? Un esempio semplice: nella gara di Go tra Lee Sedol, il campione mondiale coreano e AlphaGo, il supercomputer di DeepMind una delle mosse vincenti a sorpresa della macchina era stata giudicata e derisa dagli esperti umani come un madornale errore di strategia. Al contrario, via via che il gioco proseguiva, si è poi dimostrata essere non un errore clamoroso, ma una decisione e una mossa strategiche vincenti di straordinaria inventiva. Dunque, torno a chiedermi, cos’è filosoficamente, un errore?… > (Accoto 2024)

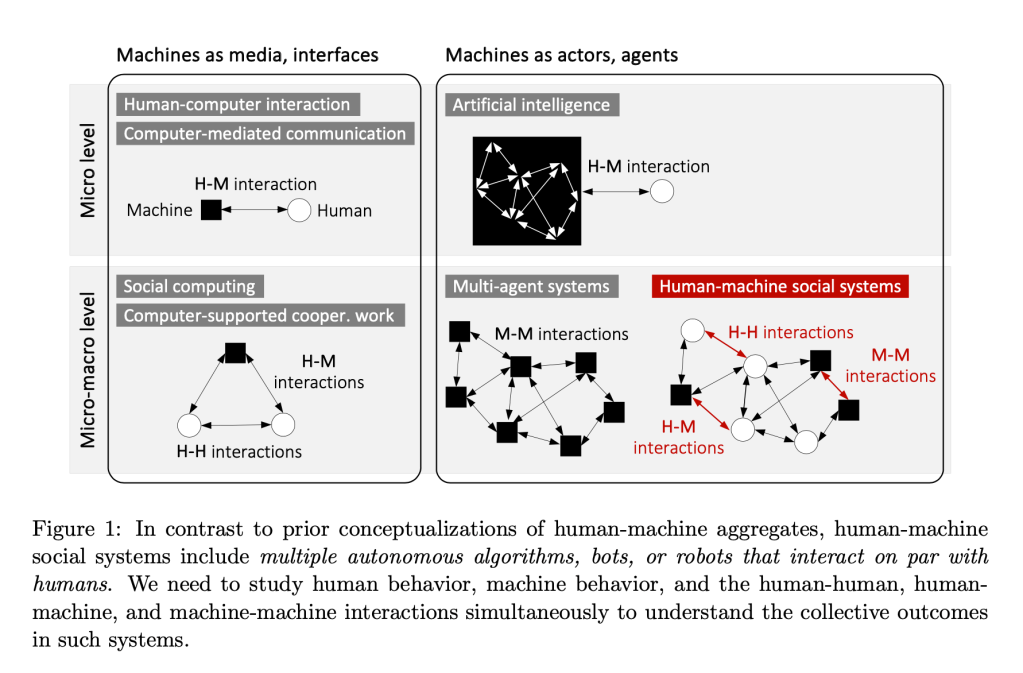

[image: “Human-Machine Social Systems”, Tsvetkova, Yasseri, Pescetelli,

Werner, 2024]

Intelligenza artificiale come provocazione di senso | preludio

L’intelligenza artificiale è un nuovo modo d’essere (abitato) del nostro pianeta. Prefigura (e configura) l’ennesima ultima terraformazione del nostro mondo, la sua imminente e altra condizione di esistenza, di esperienza e di intelligenza. Non è configurabile, tuttavia, come un’intelligenza in sé e per sé (artefatto strumentale), ma sempre e soprattutto come un’intelligenza con altri (assemblaggio sociotecnico) e per altri (costruzione sociomorfica). Non va, dunque, né reificata depotenziandola a mero insieme di tecniche inette e neutre né personificata sovradimensionandola come intelligente, cosciente, senziente alla maniera dell’umano. O, meglio, di come pensiamo che l’umano pensi. Di fatto, è insieme λόγος e ἔργον: istanzia cioè catallatticamente, simpoieticamente e proletticamente nuove cognizioni del mondo e nuove divisioni del lavoro. Come per altri passaggi nella storia della civilizzazione umana, scardinerà ordini del discorso (regimi di verità/falsità) e modi di produzione (regimi di realtà/irrealtà). A questa sfida epocale (non episodica) stiamo oggi faticosamente tentando di rispondere con strategie varie, auspicate come convergenti: istruzione educativa, regolazione giuridica, conformazione etica, direzione politica. Sono tutte necessarie naturalmente. Temo, però anche, non sufficienti. Imprescindibili, dunque, ma non bastanti per la missione ardua che ci attende sin da subito. Perché la dimensione esistenziale in divenire che abbiamo qualificato ideologicamente come < intelligenza artificiale > è, in ultima istanza, una provocazione di senso planetaria. Evoca e sostanzia, cioè, un radicale attacco culturale all’idea (storicamente costruita e diveniente) di umano e di civiltà umana. Un colpo, questo, che ha sorpreso non poco la specie sapiens arrivando a produrre, quasi all’improvviso e sulla sua viva pelle, una nuova ferita narcisistica, profonda e dolorosa. La cura approntata, ad oggi, per questo trauma da politica, educazione, etica e legge è, in buona misura, di natura narcotica (lo scrivo qui con un intento volutamente esplorativo, ma perturbante anche). È, direi, fondamentalmente una strategia sedativa delle inquietudini speciste e palliativa delle criticità tecniche. Di conseguenza, i discorsi più comuni ripetono un mantra pressoché unico e consolatorio: l’umano deve rimanere nel loop e in controllo, deve essere al centro e all’apice delle decisioni, deve confermarsi come unica soggettività intelligente, cosciente, senziente. Nella gran parte dei casi – occorre saperlo – si tratta di una forma di narcosi del pensiero talvolta accompagnata da una palese volontà anestetica dell’etica. Oltre che della politica, del diritto, dell’educazione e di molto altro. Antropologicamente condivisibile e confortante di certo, ma filosoficamente digiuna, culturalmente debole e politicamente ingenua. Perché con il dispiegarsi planetario dell’intelligenza artificiale, noi non affronteremo solo problemi tecnici (con vulnerabilità e rischi reali di discriminazioni, manipolazioni, deprivazioni, polarizzazioni, alienazioni, contraffazioni). Piuttosto e più radicalmente noi fronteggeremo delle provocazioni intellettuali. A partire da quella primaria sulla natura dell’umano (chi siamo? o meglio, chi diveniamo?) declinata poi in molte altre domande di senso e di scopo: può esistere una scrittura formalizzata senza l’autore come accade per i modelli linguistici su larga scala? e una fotografia realistica senza il referente come avviene per le immagini sintetiche? e un’autonomia decisionale della macchina senza l’umano come immaginata dagli agenti artificiali? Questi non sono solo problemi, sono anche e soprattutto provocazioni. E se ai problemi tecnici lavoreremo, nel tempo e a tentativi, per trovare una soluzione ingegneristica di qualche tipo (informatica, legale, istituzionale e così via), alle provocazioni intellettuali dovremo invece rispondere, di necessità, con l’innovazione culturale. A questo compito più alto siamo oggi chiamati tutti e tutte: alla produzione di nuovo senso e di nuovi significati per questo nostro nuovo abitare terrestre e poi in futuro, chissà, magari anche esoplanetario. Una produzione di senso che a partire dall’ardimento delle domande (che preannunciano, di fatto, una catastrofe) si faccia carico del compimento delle risposte (che indicano, a bilanciamento, un altro orizzonte desiderato, preferibile e possibile). Detto poeticamente, dobbiamo allora avere il coraggio di fare pensieri sovrumani. Per significare nuovamente e diversamente l’idea di umano (noto e dato) e promuovere nuovi orizzonti. Più inclusivi, più sostenibili, più giusti, più aperti, più prosperi e more-than-human. Sovrumani per l’appunto e non sovrani. Per orizzontare oltre il catastrofare …

(Cosimo Accoto, 2024, v.7, draft, forthcoming, continua 1/n)

Il clamore mediatico intorno al lancio di Sora, il motore text-to-video di OpenAI riporta al centro della discussione i temi strategici e filosofici che ho posto nel saggio conclusivo della mia trilogia, “Il mondo in sintesi. Cinque lezioni brevi di filosofia della simulazione”. In maniera prefigurativa, il volume anticipa quanto stiamo ora iniziando a testare e sperimentare: una nuova era inflattiva, saturante delle latenze e simulativa di mondi (dalla parola all’immagine fissa o filmica, a voci e suoni, video e audio e molto altro in prospettiva). Ma che relazione sorprendente e arrischiata c’è, strategicamente e filosoficamente, tra la macchina simulante e il mondo simulato?

<< Come ci ricorda Gaboury nella sua archeologia della computer graphics, il nostro spazio fisico e mentale è oggi sempre più saturo di questi oggetti-immagine, che spesso tuttavia sfuggono alla nostra consapevolezza, restando a noi invisibili. Queste simulazioni sono di fatto il risultato di una computazione che col tempo ha imparato a ricostruire volumetrie e geometrie. In forma di spazi, di oggetti e di corpi. Una computazione che sa ricreare mondi, dunque, e non solo fare calcoli. Da semplice calcolatrice ed emulatrice del pensiero, la macchina è divenuta simulativa e mimetica del mondo. Se il cervello umano è più un simulatore che un calcolatore come si comincia a sostenere, allora forse potremmo azzardare anche una suggestione. E cioè che è la grafica computerizzata ad avvicinare la macchina al cervello in questa sua capacità di immaginare e simulare costantemente mondi […] Ma che rapporto c’è, dunque, tra realtà fisica e simulazione informatica in ultima istanza? Che cosa possiamo dire di questa nuova relazione tra macchina (che simula) e mondo (simulato)? A ben vedere, oggi possiamo guardare alla simulazione computazionale come a un nuovo modo di interrogare e instrumentare il mondo. La simulazione non è semplicemente teoria applicata e non è neanche solo un nuovo tipo di esperimento. Si situa in una terra di mezzo. È al contempo una nuova forma mentis e un nuovo modus operandi. Il metodo computazionale simulativo, teoretico e strumentale è insieme – dicono i filosofi della scienza – uno «stile di ragionamento» della modellizzazione matematica che privilegia due peculiari dimensioni cognitivo-operative: l’iterazione e l’esplorazione. È quindi una pratica epistemica che affronta la complessità del mondo con nuove strumentalità e nuove metodiche. Detto in maniera piana e breve, la sua caratteristica generale è la capacità di accorciare la distanza tra modello e mondo […] Il modello del mondo, a quel punto, diviene, il mondo del modello >> (Il mondo in sintesi. Cinque brevi lezioni di filosofia della simulazione, Accoto)